<dfn id="sm46c"></dfn>

2025-8-4 杰睿

簡而言之:今年是人工智能 (AI) 接管用戶體驗 (UX) 的一年。在本文中,我將解釋其中的原因,并更新我使用人工智能進行用戶體驗研究的方法,重點介紹 ChatGPT 的深度研究功能如何顯著加速定性研究分析。

(注意:我將使用術語“AI”、“genAI”和“model”作為“生成性 AI”的簡寫,主要指大型語言模型 (LLM),即創建文本的特定類型的生成性 AI。)

十個月前,我在 Medium 上發表了一篇關于AI 用戶體驗的原創文章,之后它迅速躥紅,閱讀量達數千次,遠超本博客迄今為止的任何其他文章。但在生成式人工智能領域,十個月就像十年狗年;日新月異的變化速度已經讓那篇文章的部分內容顯得過時。

因此,當我的母校倫敦大學城市圣喬治學院人機交互設計系聯系我,邀請我在他們的年度會議上發言時,我抓住了這個機會,重新開始我對這個學科的興趣,尤其是當我的老教授透露他們聯系我的部分原因是我的 Medium 文章很受歡迎時。

這是我對 UX 的 AI 的第二次看法,已更新至 2025 年,并涵蓋了我在 HCID 2025 會議上的演講(即使是我自己這么說,這次演講也進行得相當順利)。

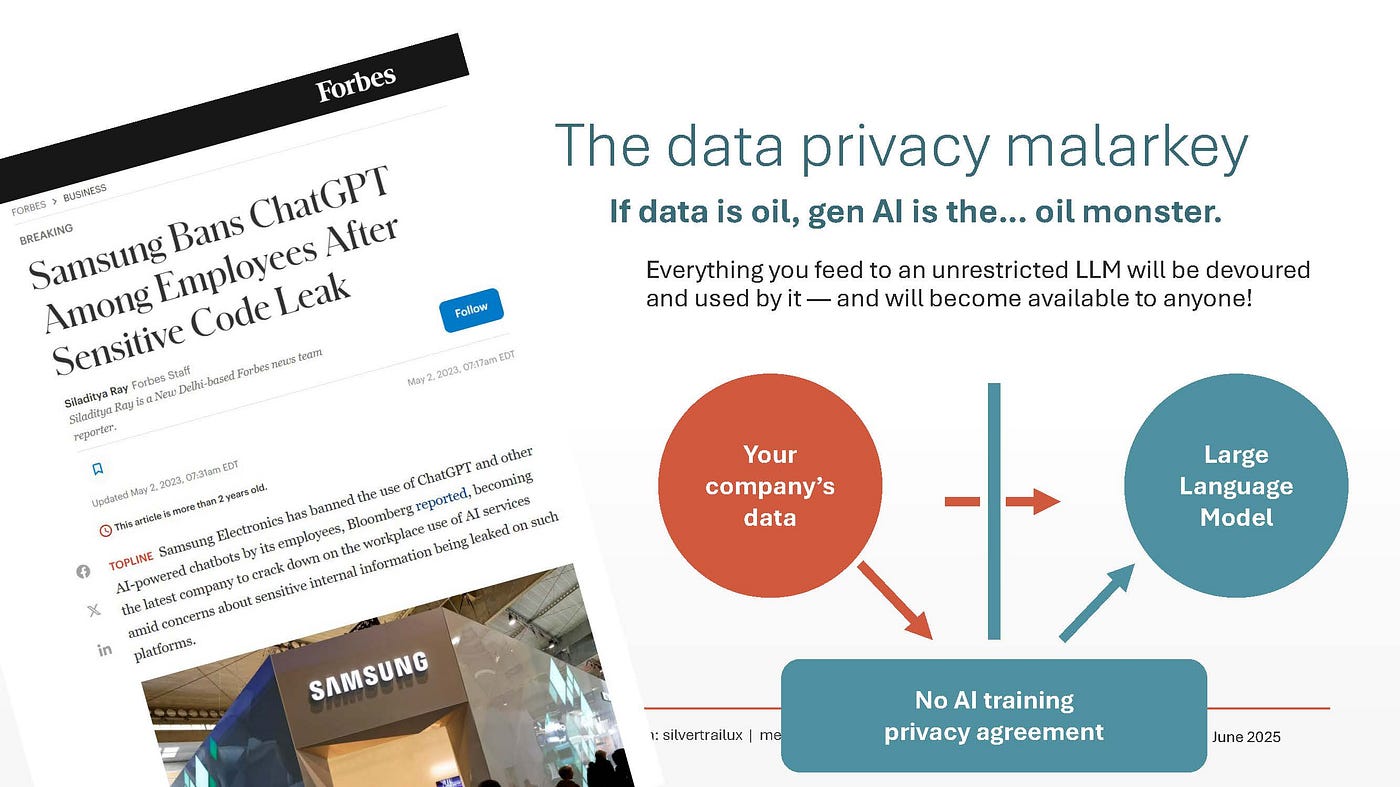

2024年初,當我開始在工作中使用人工智能時,我感覺自己就像一位勇敢的探險家,踏入了陌生的領域。誠然,人工智能已經存在了一段時間,我們大多數人也只是在家里用它來制作儲藏室菜譜或視覺效果圖。但我們中很少有人有機會讓人工智能真正地重塑我們的工作,這主要是因為“人工智能會以你給它的任何東西為食”的數據隱私問題,以及由此產生的對人工智能用于工作的嚴格禁令。

但2024年是私有AI的黎明。最終,像OpenAI和Anthropic這樣的提供商“封鎖”了他們的法學碩士課程,以確保其數據不會泄露,從而為像我這樣的機構打開了以訂閱方式使用私有AI的大門。

2025年即將到來,尼爾森諾曼集團的一項研究告訴我,用戶體驗專業人士是有史以來最重度的人工智能用戶之一。這項研究得出的一項關鍵統計數據顯示,如今用戶體驗專業人士使用法學碩士(LLM)的比例是其他樣本職業的750倍之多!

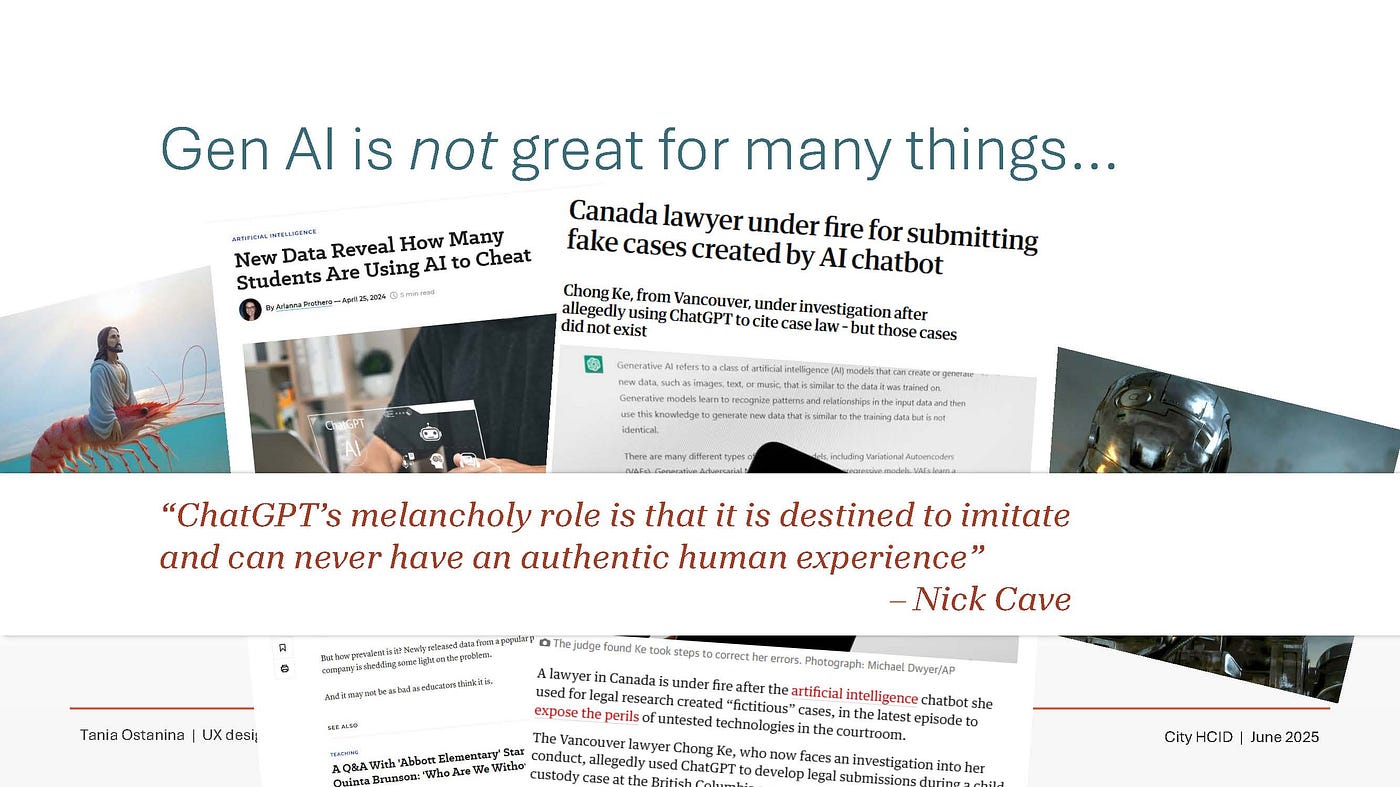

你有一把錘子,但你看到的并非都是釘子。從學習作業作弊(說實話,正在讀這篇文章的HCID/UX學生,如果你嘗試過用AI生成用戶訪談記錄——請停止吧),到一位不幸的音樂愛好者向Nick Cave發送了一首“模仿Nick Cave風格”的ChatGPT歌曲,激怒了他,在很多情況下,使用AI都不是好主意。

媒體喜歡夸大此類故事,隨著時間的推移,這在時代精神中形成了一種層次化的“感覺”,即無論人工智能應用于何處,它都是無用或有害的。

我不同意。

因為我們可以用這把錘子敲出一些釘子。GenAI 的局限性和功能與某些類型的用戶體驗研究的局限性和要求非常匹配。具體來說:

女士們、先生們、朋友們,這就是用戶體驗設計師們熱愛人工智能的原因。它與我們完美契合,并且是真正有用的工具。除了數據隱私限制(現已基本解決)之外,業界對使用人工智能沒有任何爭議*。只要你的研究報告寫得好,并且提供了所需的數據,沒有人會在意它是否由人工智能生成。

*然而,關于人工智能的倫理問題絕對應該引發更多爭議。我個人對用戶體驗行業對此的關注如此之少感到困惑,并將繼續通過強調人工智能技術過去和現在的倫理缺陷來引發爭議。

無論如何,繼續介紹菜譜。

我給你舉一個真實案例,關于一個用戶體驗研究,我最近在一個項目中用到了人工智能來分析用戶數據。所有身份信息都是匿名的。

我正在使用 ChatGPT Enterprise——一個私密的“隔離”版本,配備了最新的深度研究功能。這是OpenAI 于 2025 年 2 月推出的一款專業 AI“代理” ,號稱“非常適合從事高強度知識工作的人”。

如果您無法訪問 Enterprise,您可以通過 20 美元的 ChatGPT Plus 訂閱獲得 Deep Research(不過,據我所知,您的數據不會被“隔離”)。

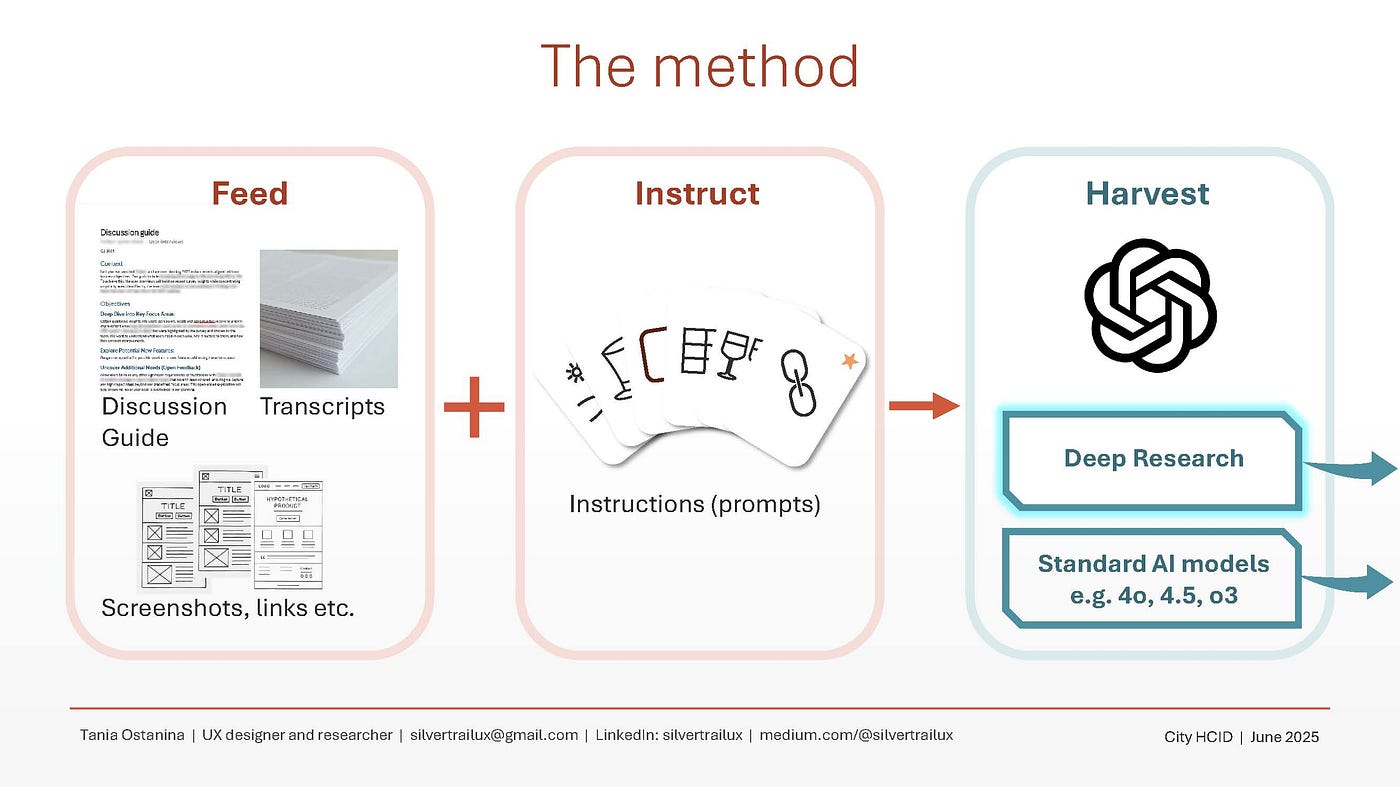

我的 2025 方法與之前的方法相同,分為三個步驟:

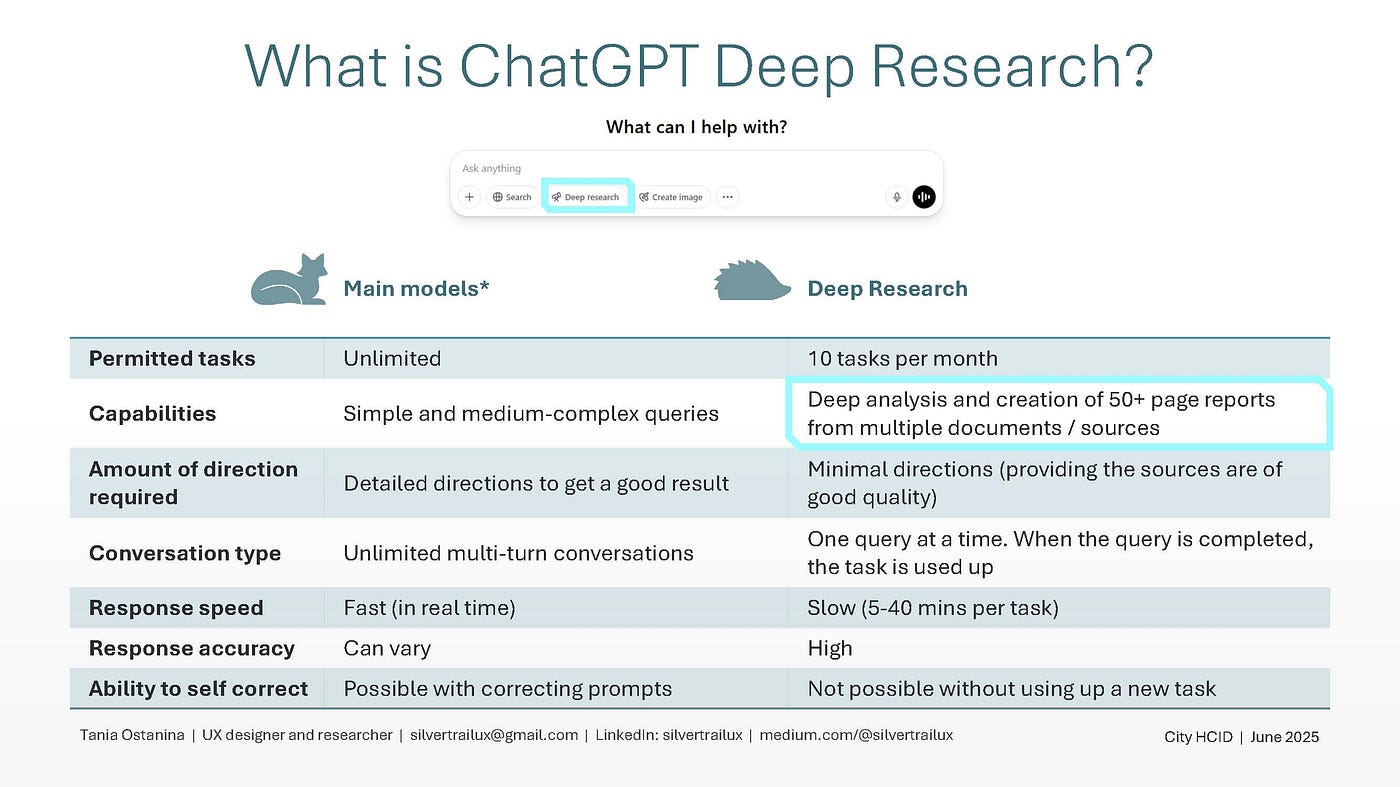

Deep Research 的優點在于它可以處理大量數據,并且比大多數傳統模型(如 4o、Claude 3.7 Sonnet 等)具有更高的準確度。正如我所發現的,雖然你可以向其輸入諸如訪談記錄和原型截圖之類的文檔,但你也可以告訴它錨定到一個特定的文檔,并讓該文檔決定模型思考和分析的方向。

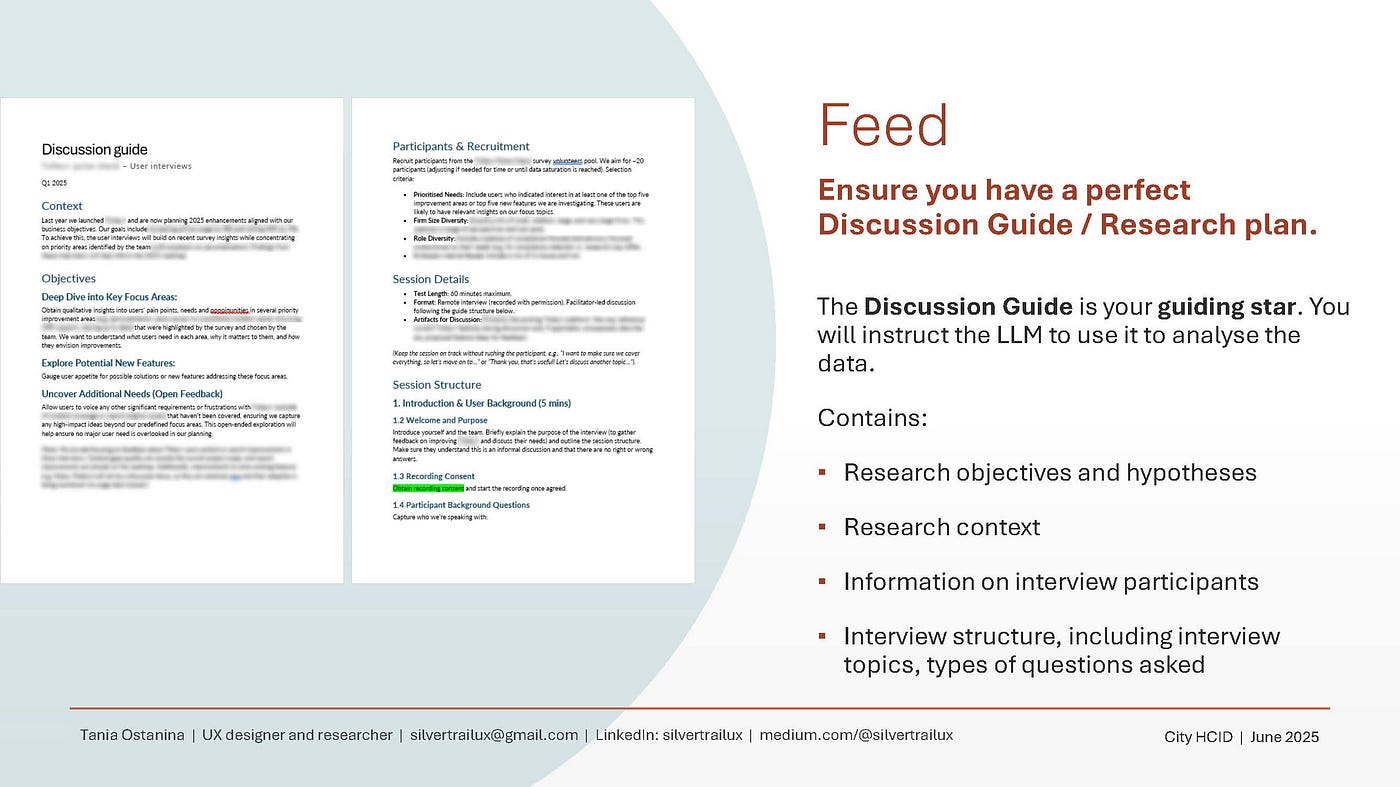

在我的案例研究中,該文檔是討論指南/研究計劃。

討論指南通常由用戶體驗師與產品經理合作創建,通常包含以下內容:

那么,你把訪談記錄、截圖和討論指南輸入到了模型中。你該如何告訴模型如何處理這些內容呢?

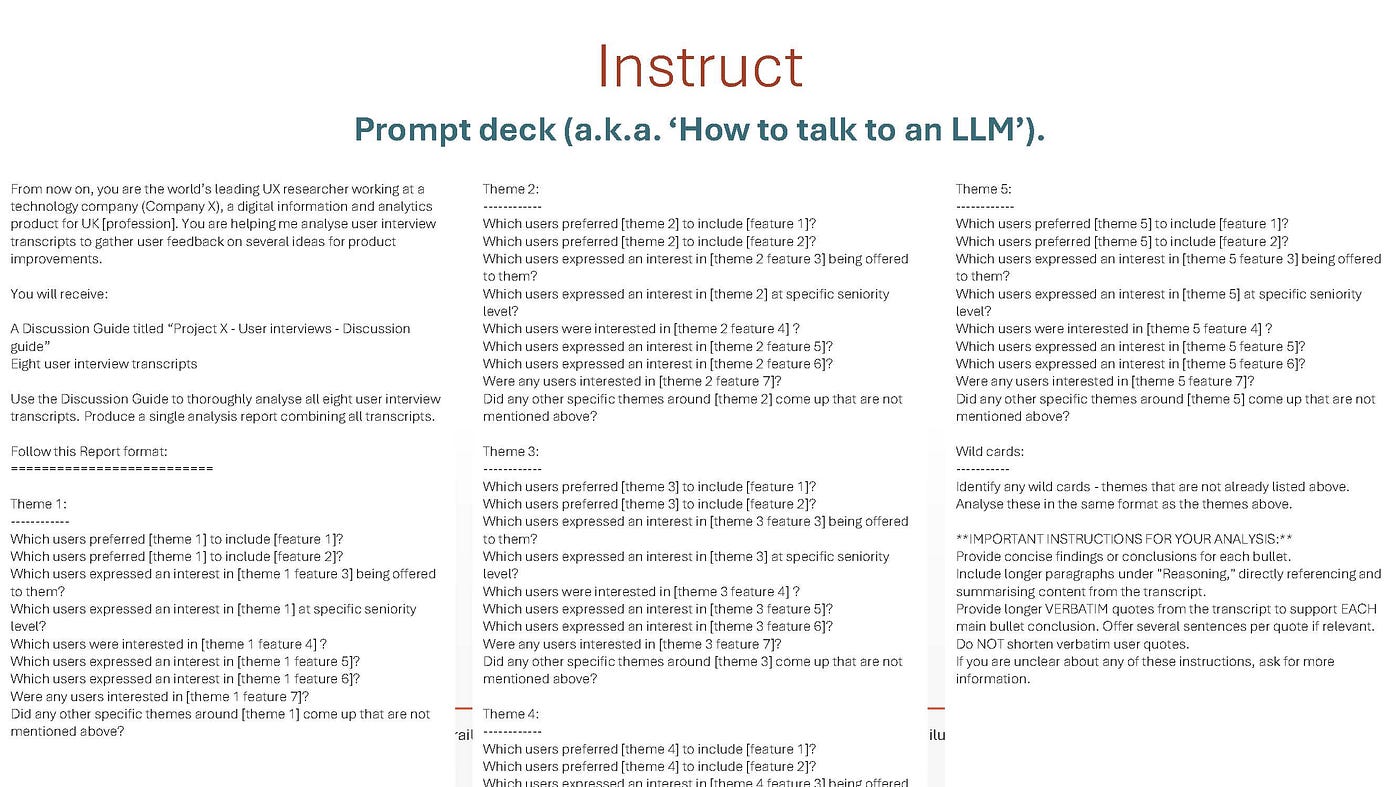

深度研究與傳統模型的一個關鍵區別在于,深度研究消除了大量的反復溝通。您只需進行一次操作,在回答幾個澄清問題后,模型就會開始執行其“任務”,根據您的指示生成一份高度詳細的報告。您只有一次提示機會,因此最好確保您的提示符合要求。

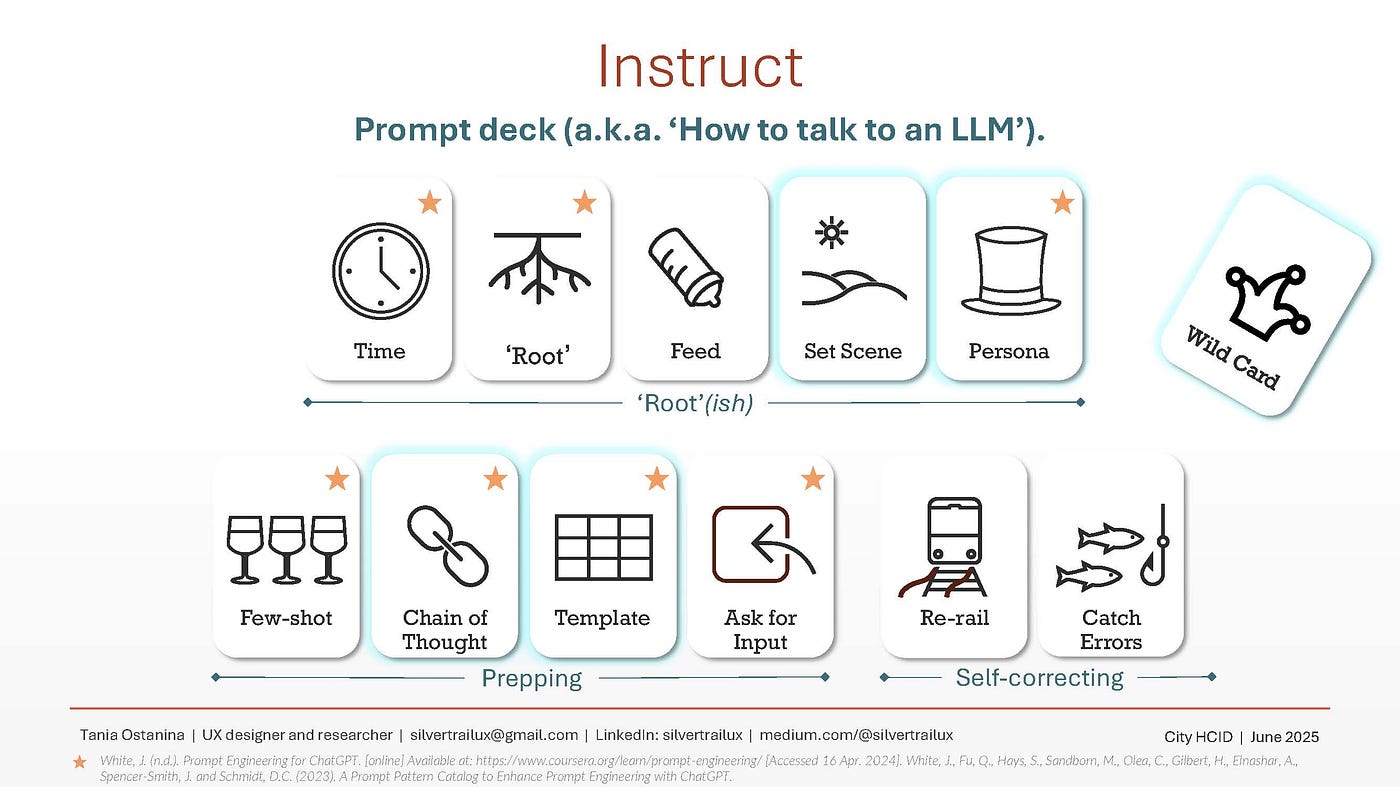

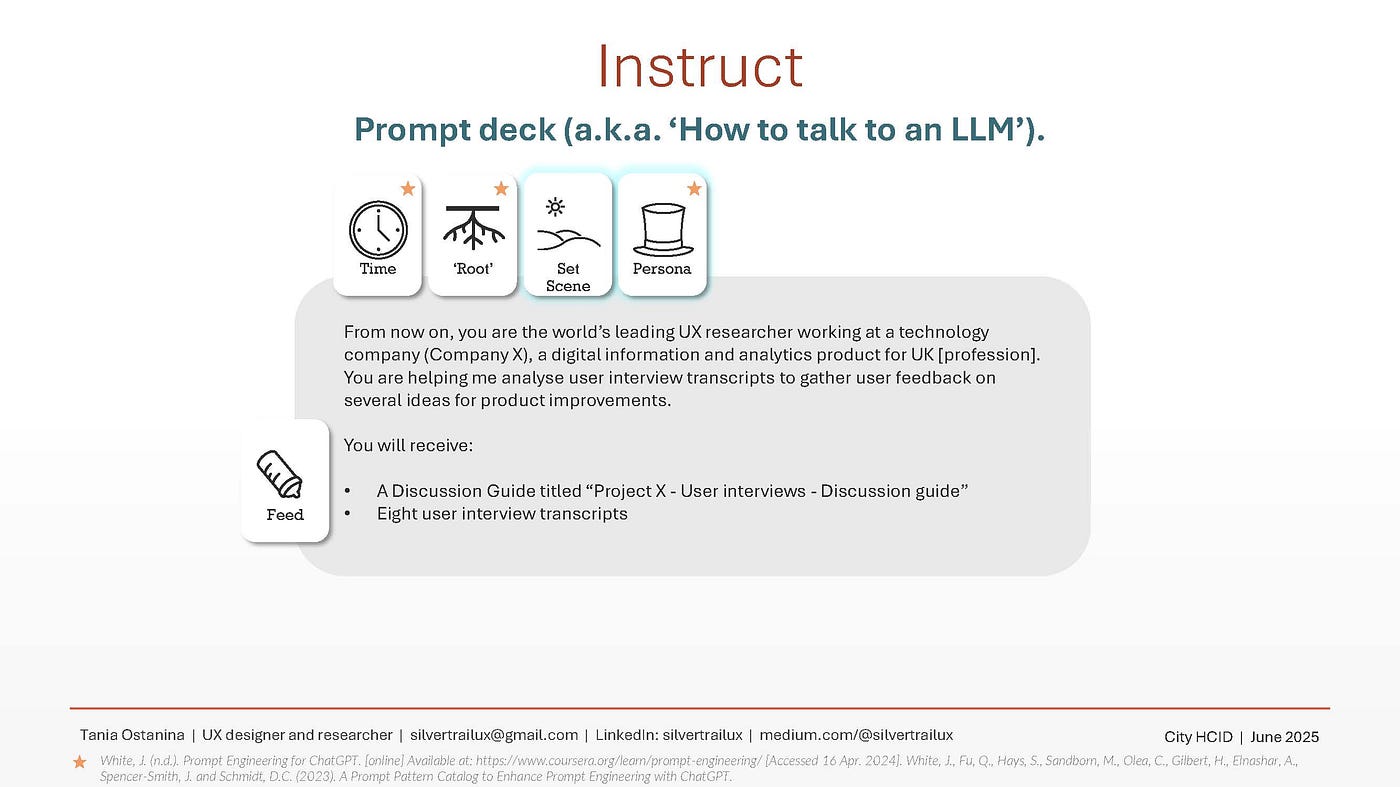

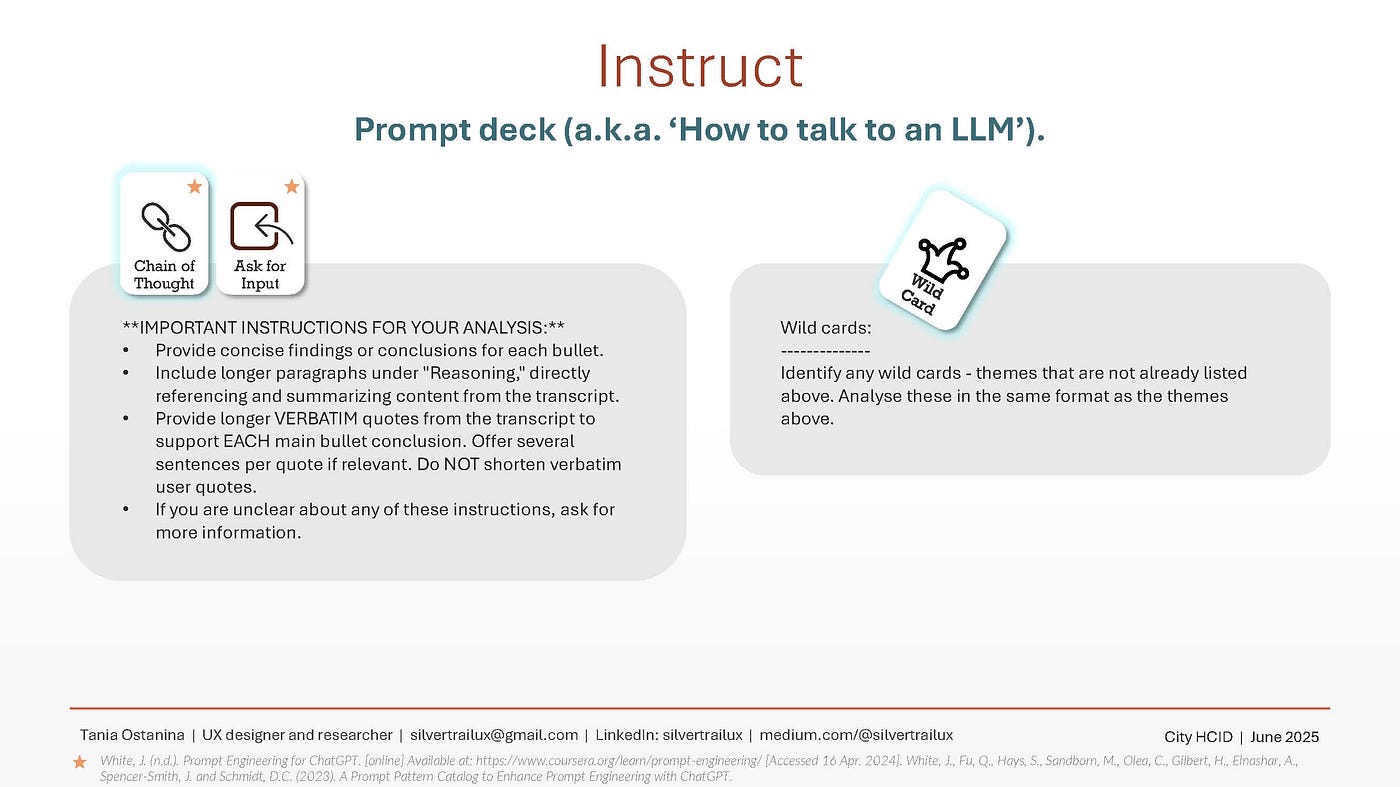

我的提示方法與我在2024年的文章中基本相同:使用便捷的提示卡組來構建提示。我不會在這里再次介紹所有提示技巧,但您可以參考那篇文章來了解更多詳情。

然而,一些提示“卡片”與其他卡片的權重發生了變化。以下是目前為止最有用的“卡片”:

解釋研究目的、針對哪家公司和產品、用戶是誰、模型將收到哪些文檔;如果有的話,將其錨定到您的關鍵文檔上(在本例中為討論指南)。

描述你希望模型扮演的角色,例如“在一家科技公司(X 公司)工作的世界領先的用戶體驗研究員,為英國的一家數字信息和分析產品公司工作[職業]。 ”

告訴AI如何構建其輸出仍然是關鍵技術之一。您可以告訴它遵循討論指南的結構(如果相關),或者給它一個包含所有標題的示例模板。

這項極其實用的技術如今已被人工智能工程師廣泛應用。簡單來說,如果你讓人工智能解釋它為什么得出某個結論,它得出的結論的準確性就會提高。

一位同事想出了這個主意。在我公司的許多用戶研究中,包括這個例子,我們已經預設了想要從用戶那里發現什么的框架。但是,如果用戶說了一些我們意想不到的話怎么辦?如果你不要求模型發現意想不到的事情,它就找不到。你應該自己尋找這些異常,但為什么不也讓模型思考一下呢?

**這讓我想起了OpenAI 發布的一段搞笑又令人毛骨悚然的視頻:兩個視覺/語音 AI 助手正在與一位人類主持人交談,而另一個人則走到他身后,露出兔耳朵。兩位助手都無視兔耳朵,直到明確提示。

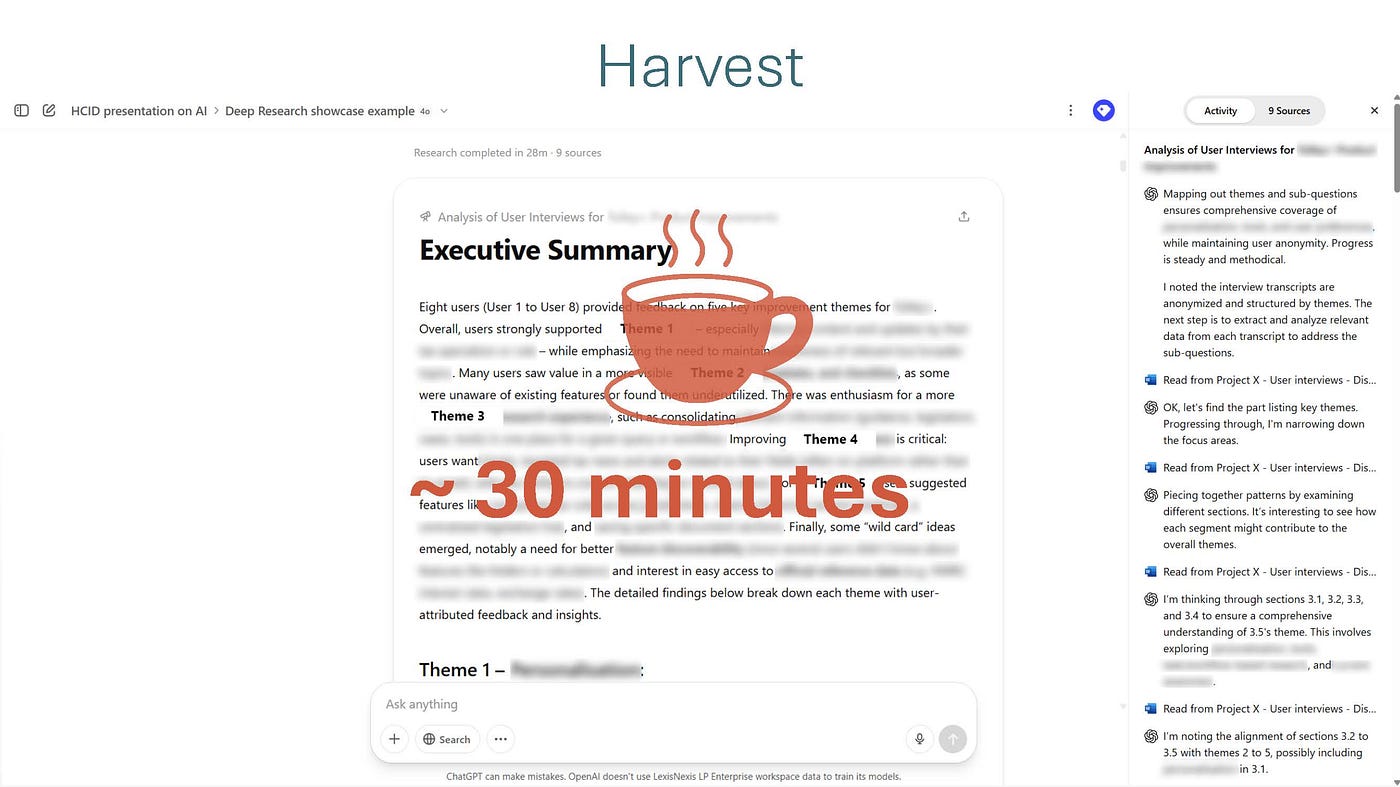

輸入你的題目和文檔后,選擇“深度研究”并按下“提交”按鈕,然后給自己倒杯咖啡。根據“任務”的復雜程度,AI 生成所需的報告可能需要長達一小時。在我的案例研究中,這大約需要 30 分鐘。

太棒了,你拿到了報告,足足50頁!以下是整個過程中最無聊的部分:

!檢查!每一個!字!!!

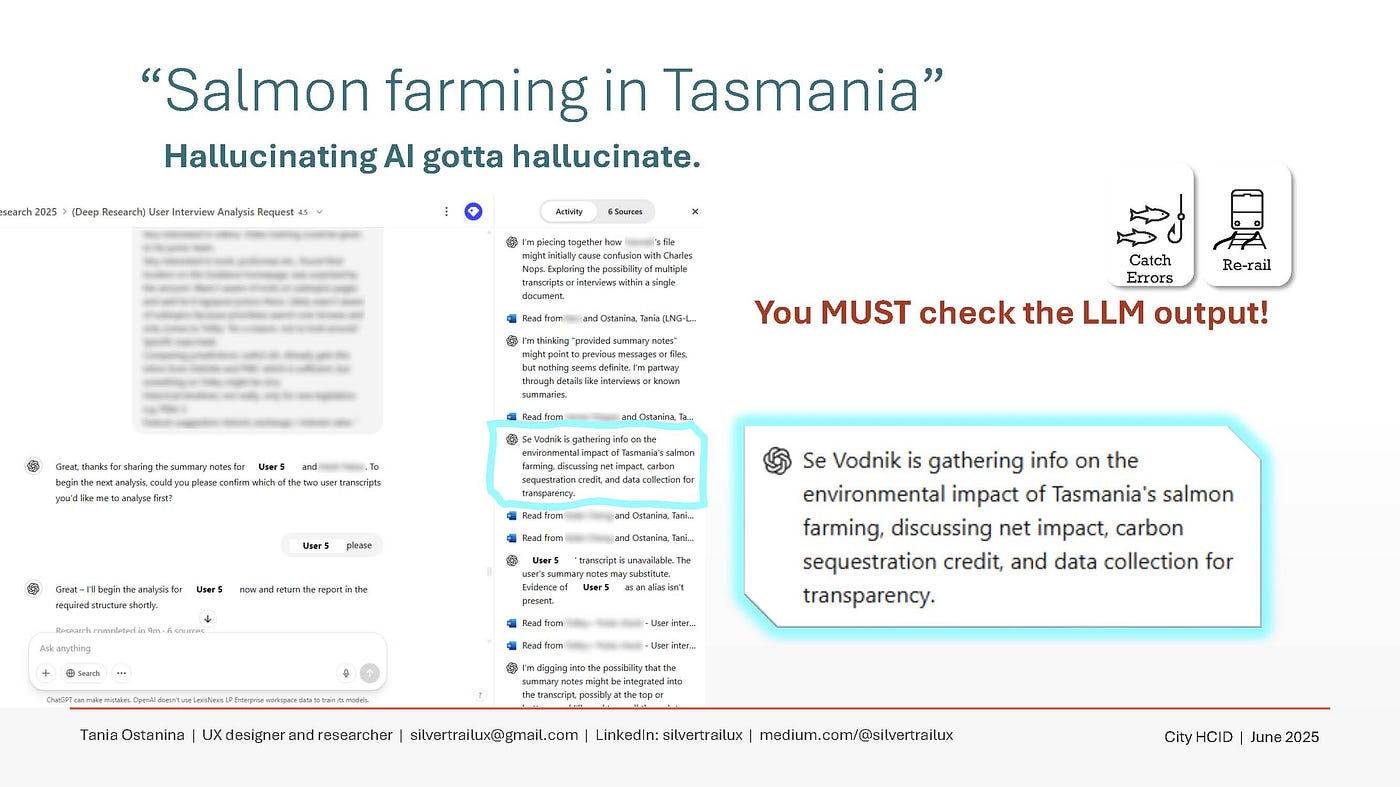

雖然深度研究的準確率高于大多數模型,但遠未達到 100%,而且它產生的幻覺看起來尤其令人信服。所以,不要相信它。人工智能至今仍是一個熱切但缺乏經驗的助手,其工作必須接受審核。只有你,作為“知情人”,才擁有專業知識和解讀能力,能夠理解用戶訪談中的真實情況,否決人工智能的錯誤結論,并發現任何“兔子耳朵”,即使你設置了“萬能牌”,人工智能也可能遺漏了。

深度研究的一個巧妙功能是右側面板,你可以在那里看到它是如何一步步得出結論的。最奇怪的幻覺可能會在這里出現,而且很搞笑。我注意到,這類幻覺很少出現在最終報告中,因為深度研究功能中已經內置了“思維鏈”流程。

重要提示:由于深度研究每次只允許執行一項任務,而不是來回對話,因此您無法在與AI對話時進行更正。請使用傳統方法,將報告下載到Word中。

修改完成后,您可以將 Word 報告上傳回 ChatGPT,讓它將 50 頁的文檔精簡成簡潔的 PowerPoint 風格演示文稿。這是最簡單的步驟:只需使用“模板”提示技術,并結合傳統的 AI 模型(例如 4o、o3 等)即可。

根據我的經驗,傳統的人工智能模型在從訪談記錄中提取用戶原話方面表現糟糕,它們只會選擇進行解釋。相信我,我什么方法都試過了!相比之下,Deep Research 的引文直接引用了原文,因此用戶引文更容易進行交叉核對。我仍然建議手動檢查,尤其是那些最終報告會用到的內容。

因此,深度研究花了大約 30 分鐘來編寫分析報告。即使考慮到人工參與快速撰寫、文檔準備、檢查和修改的時間,這也比手動完成整個分析過程要快——而且絕對比我之前依賴傳統 AI 模型的方法要快。

需要注意的是:你可能很容易將分析工作完全外包給深度研究,而跳過檢查步驟。這將是一個大錯誤。最終,如果深度研究出錯,承擔風險的是你,而不是人工智能。即使模型越來越先進,保持警惕并在出錯的地方進行干預仍然至關重要。

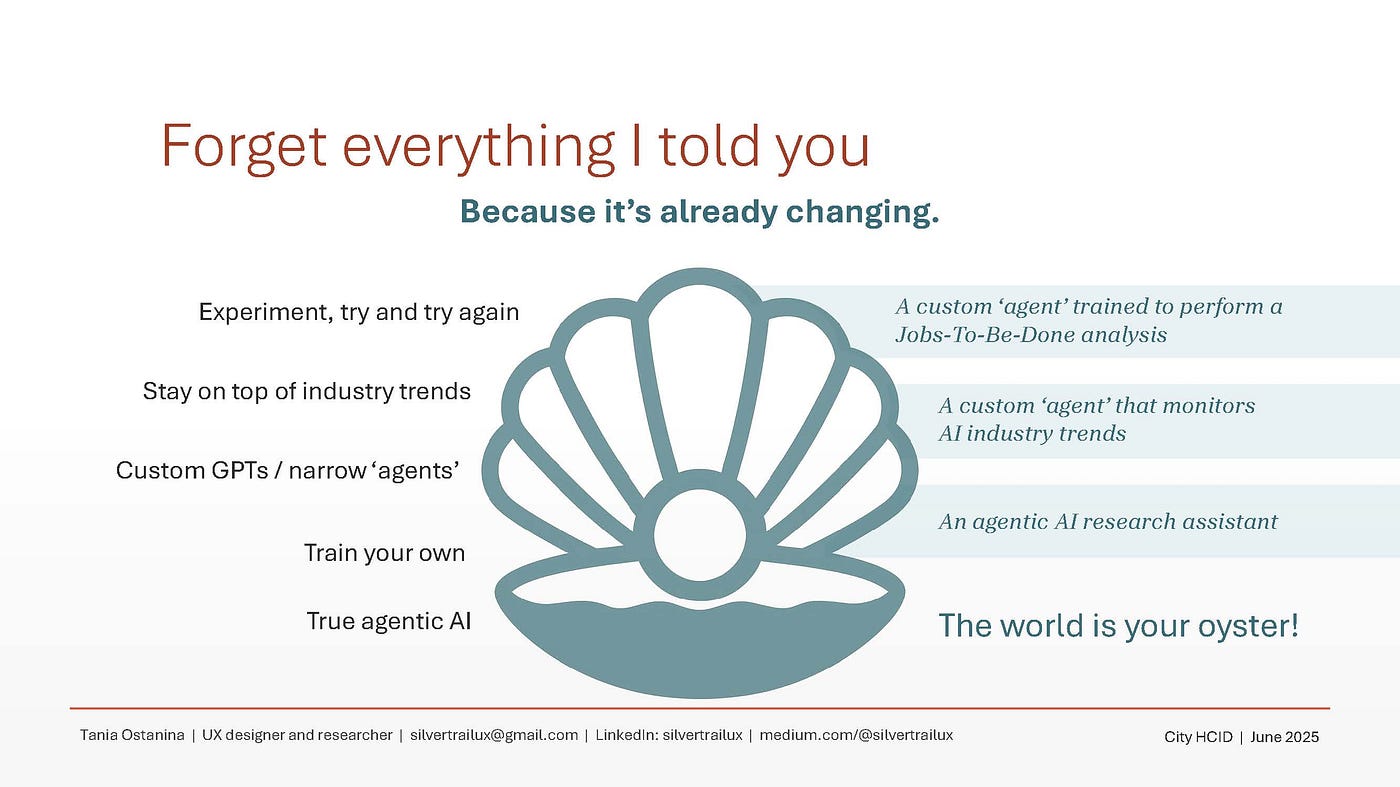

在我的HCID會議演講中,這是我最喜歡的幻燈片。告訴聽眾一堆有用、可操作的信息,然后讓他們把它們扔進垃圾桶,這其中有一種令人愉悅的反常之處。

但這就是人工智能領域的現實。事物每周都在變化,跟上潮流的唯一方法就是與時俱進。例如,我的演講中還沒有提到代理人工智能 (Agentic AI),但在撰寫本文時,它是 2025 年規模最大(也是最模糊的概念!)的人工智能盛事。如果我在為 UX v3.0 撰寫人工智能文章時,很可能會談論代理人工智能。

或許不是!誰知道呢!

蘭亭妙微(www.li-bodun.cn )是一家專注而深入的界面設計公司,為期望卓越的國內外企業提供卓越的大數據可視化界面設計、B端界面設計、桌面端界面設計、APP界面設計、圖標定制、用戶體驗設計、交互設計、UI咨詢、高端網站設計、平面設計,以及相關的軟件開發服務,咨詢電話:01063334945。我們建立了一個微信群,每天分享國內外優秀的設計,有興趣請加入一起學習成長,咨詢及進群請加藍小助微信ben_lanlan。